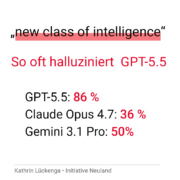

GPT-5.5 und Halluzinationen

OpenAI hat mit GPT-5.5 ein Modell ausgeliefert, das mehr weiß als jedes andere aber auch häufiger Blödsinn erzählt als jedes andere.

Im AA-Omniscience-Benchmark erreicht GPT-5.5 die höchste Genauigkeit aller bisher getesteten Modelle: 57 Prozent. Im selben Benchmark liegt aber die Halluzinationsrate bei 86 Prozent.

Zum Vergleich: Claude Opus 4.7 halluziniert mit 36 Prozent, Gemini 3.1 Pro Preview mit 50 Prozent.

Genauigkeit und Halluzinationsrate bei LLMs

Genauigkeit und Halluzinationsrate werden oft behandelt, als wären sie zwei Lesarten desselben Werts. Sie messen aber zwei völlig unterschiedliche Kompetenzen.

💡 Genauigkeit fragt: Wenn das Modell antwortet, wie oft hat es recht?

💡 Halluzinationsrate fragt: Wenn das Modell die Antwort nicht weiß, sagt es das – oder erfindet es etwas?

Diese beiden Achsen sind nicht gekoppelt. GPT-5.5 ist der Beleg: Der 14-Punkte-Sprung gegenüber GPT-5.4 in der Genauigkeit kam laut Artificial Analysis fast vollständig aus mehr abgespeichertem Wissen. Die Selbsteinschätzung hat sich dabei kaum verbessert. Das Modell weiß mehr UND es rät mehr.

👉 Die praktische Konsequenz hängt an der Aufgabe.

Bei wissensintensiven Aufgaben mit hoher Verantwortung – dort, wo Antworten weiterverarbeitet, zitiert oder als Entscheidungsgrundlage genutzt werden – ist eine selbstbewusst falsche Antwort schädlicher als ein “weiß ich nicht”. Hier zählt Abstinenzbereitschaft mehr als Wissensbreite. Auf dieser Achse ist GPT-5.5 dafür das schwächere Werkzeug, obwohl es im aggregierten Index führt.

Genauigkeit misst, was ein Modell aus seinen Daten korrekt wiedergibt. Halluzinationsrate misst, ob es zeigt, was es nicht weiß.

Das eine ist Wissen. Das andere ist Urteilskraft.

Hier geht es zum Beitrag auf LinkedIn: GPT-5.5 und Halluzinationen